Hvordan vi skabte Danmarks første landsdækkende, sammenlignelige analyse af ambulance-responstider – og hvad vi lærte undervejs

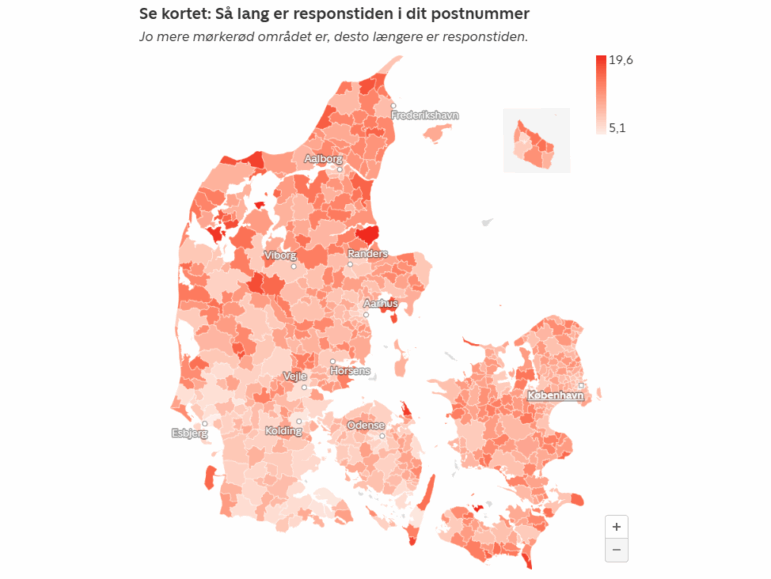

Når TV2 i dag kan fortælle, at ambulancen i nogle postnumre er fremme på 5 minutter, mens den andre steder tager næsten 20 minutter, bygger det på et omfattende dataprojekt, der tog flere måneder at gennemføre.

Her er historien om, hvordan vi gik fra en simpel idé til 2 millioner analyserede ambulanceture.

Problemet: Usammenlignelige tal

Alle fem regioner offentliggør nøgletal for ambulance-responstider. Men de kan ikke sammenlignes direkte.

Hvorfor? Fordi regionerne definerer “responstid” forskelligt:

- Nogle måler fra det øjeblik, opkaldet modtages

- Andre fra alarmen aktiveres

- Andre igen fra ambulancen disponeres

- Og stoptidspunktet varierer også: Ankomst på stedet? Første patientkontakt?

Det er som at sammenligne æbler og appelsiner. Hvis Region A rapporterer 8 minutters responstid, og Region B rapporterer 10 minutter, ved vi ikke, om A faktisk er hurtigere, eller om de bare måler en kortere tidsperiode.

Løsningen: Én ensartet definition

Vi besluttede at bede om rådata fra alle regioner og selv skabe én sammenlignelig definition: Tiden fra ambulancen disponeres, til den ankommer på stedet.

Denne definition er retfærdig, fordi:

- Disponeringen markerer, hvornår systemet handler

- Ankomsten er objektiv og dokumenterbar

- Begge tidspunkter findes i alle regioners systemer

Aktindsigtsprocessen

Vi sendte parallelle aktindsigtsanmodninger til alle fem regioner tidligere på efteråret. Anmodningerne var koordineret med Regionsrådsforeningen for at sikre, at vi bad om data i et format, regionerne faktisk kunne levere.

Det gode samarbejde med Regionsrådsforeningen var afgørende. De hjalp os med at forstå:

- Hvilke variabler der findes i regionernes systemer

- Hvordan datastrukturerne adskiller sig

- Hvilke begrænsninger der er for udtræk

Uden denne dialog risikerede vi at bede om data i formater, der ville være umulige eller urimeligt tidskrævende at producere.

Datarensning: Det usynlige arbejde

Når man modtager 2 millioner rækker data fra fem forskellige systemer, er rensningen mindst lige så vigtig som analysen.

Her er nogle af de udfordringer, vi stødte på:

Blandede responstyper: Regionernes data inkluderede ikke kun ambulancer, men også akutlægebiler, paramedicinerbiler og i nogle tilfælde helikoptere. Vi måtte filtrere for kun at inkludere egentlige ambulanceture.

Invalide tidsstempler: Enkelte datarækker havde negative responstider (ankomsttid før disponeringtid) eller ekstreme outliers (responstider på flere timer). Disse blev identificeret og håndteret.

Geografisk kodning: Vi skulle mappe hver tur til et postnummer, hvilket krævede validering af adressedata.

Manglende værdier: Ikke alle ture havde komplette data. Vi måtte beslutte, hvordan vi håndterede manglende værdier uden at skævvride resultaterne.

Dette er klassisk data-rensearbejde. Tidskrævende, ikke glamourøst, men absolut afgørende for analysens integritet.

AI som værktøj, ikke erstatning

Et interessant aspekt af projektet var kombinationen af traditionelt Excel-arbejde og AI-assisteret analyse.

AI hjalp med at identificere mønstre i store datasæt hurtigere, spotte anomalier og potentielle datakvalitetsproblemer, Generere og validere kode til databehandling og til at dokumentere metodiske overvejelser. Men AI erstattede IKKE journalistisk dømmekraft. Beslutninger om, hvilke outliers der skulle ekskluderes, hvordan vi håndterede edge cases, og hvilke metodiske valg der var rimelige – det krævede menneskelig vurdering.

Det er en arbejdsdeling, vi tror, bliver standard i datajournalistik: AI accelererer det tekniske arbejde, mennesker sikrer den journalistiske integritet og relevans.

Hvad tallene viser – og hvad de ikke viser

Den færdige analyse afslører betydelige geografiske forskelle. Fra 5-6 minutters gennemsnit i tætbefolkede områder til næsten 20 minutter i de mest ekstreme tilfælde.

Men som professor Søren Mikkelsen påpeger i TV2’s artikel, vi linker til nedenfor, er sammenhængen mellem responstid og overlevelse mere kompleks end intuitivt antaget. Bortset fra hjertestop kan forskningen ikke påvise en klar sammenhæng.

Det er en vigtig nuance. Tallene viser en geografisk ulighed, men konsekvensen af den ulighed er ikke entydig.

Hvad vi lærte

Tre centrale indsigter fra projektet:

- Standardisering er afgørende. Så længe regioner måler og registrerer forskelligt, er offentlig sammenligning umulig. Det er ikke nødvendigvis på grund af manglende vilje – det er bare ikke koordineret.

- Rådata slår aggregerede tal. Ved at få adgang til de underliggende data kunne vi skabe vores egen, ensartede definition. Det giver mere arbejde, men også langt større troværdighed.

- Samarbejde virker. Dialogen med Regionsrådsforeningen gjorde forskellen mellem at bede om noget umuligt og at få brugbare data.

Projektet understreger samtidig værdien af datajournalistik: At tage offentligt tilgængelige (men ikke umiddelbart sammenlignelige) informationer og gøre dem til noget, borgerne kan bruge i deres hverdag og i deres forståelse af samfundet.

Tak til TV2 Nyhederne for opgaven, samarbejdet og den journalistiske behandling af tallene. Og tak til Regionsrådsforeningen for at hjælpe os med at forstå de systemer, vi analyserede. Illustration: TV2.

Research og analyse er udført af Adam Hvidt, som også har skrevet artiklen. Adam er journalist og data-researcher hos Kaas & Mulvad. Kontakt: adam@km24.dk

Kaas & Mulvad kører kurset ”Datajournalistik i en AI-tid” 27.-29. april 2026 i København.

No comments yet.